Humanos são um problema para o meio ambiente. A inteligência artificial é um problema por si só

Quer reclamar da proliferação das inteligências artificiais? Cansado de crítica teatral de um lado e hype insano com o outro? Ótimo, venha reclamar comigo, be my guest

No campo progressista, eu identifico duas correntes principais na crítica dos atuais serviços que oferecem avatares conversacionais como instrumento de interação com imensos modelos baseados em linguagem natural (os tais LLMs, na sigla em inglês):

- Violação de propriedade intelectual ou subversão de propriedade intelectual, potencialmente erodindo trabalhos artesanais, como design; e

- Elevado consumo de recursos computacionais, o que se traduz em impactos no consumo energético e infraestrutura física para processamento de dados (como grandes agrupamentos de computadores de alto desempenho, com dissipação de calor substancial e necessidade de sistemas adequados de resfriamento).

Em geral, eu acho que o argumento ambiental não tem apelo adequado e, mais ainda, é frágil por ser trivialmente confrontado com a seletividade humana em torno de causas. Colocando em outros termos, talvez mais simples, acho difícil falar de uso responsável de recursos quando:

- Normalizamos cidades espraiadas e fortemente orientadas para serem percorridas usando automóveis;

- Adotamos ecossistemas de software e hardware proprietários, notadamente aqueles que envolvem elevada filtragem socioeconômica, tais como o da Apple;

- Minamos deliberadamente alternativas às redes sociais hegemônicas, contribuindo para sustentar negócios que exercem exploração psicológica a partir de condicionamento algorítmico, inclusive para oferta de produtos e serviços;

- Trivializamos a obsolescência programada e exercemos pouca crítica em torno do que é, de fato, inovador e necessário, e do que não é, contribuindo para a geração massiva de lixo eletrônico;

- Adotamos tecnologias perdulárias altamente capilares, subutilizando o poder de processamento de inúmeros tipos de dispositivos, mas, principalmente, de computadores em geral, o que se traduz em camadas de abstração excessivas e problemas de usabilidade.

Cada um dos pontos que elenquei acima poderia ser objeto de uma dissertação ou tese acadêmica. Cada ponto, isoladamente ou em conjunto, poderia dar origem a um ou mais livros. Entretanto, nenhum dos pontos esbarra no que eu quero abordar.

Desculpe, mas com o ruído percebido por mim, senti a necessidade de um prólogo.

Meu problema com as inteligências artificiais vai além dos debates hipócritas e preguiçosos — desculpe se ofendi alguém, mas estou cansado de adultos infantis e de ativismo que se transforma no mesmo consumo insípido que se propõe a combater —, na verdade, vai além sem chegar nos debates.

As tais inteligências artificiais, tais como oferecidas hoje, são um formidável espetáculo que mistura fascínio, ingenuidade e horror, praticamente, uma distopia suave.

Tanto no campo profissional quanto no pessoal, atingi um nível de pressão tal que não havia escolha: eu precisava assinar os dois principais serviços do mercado e tecer comentários mais qualificados, com casos de uso reais, incluindo solicitações profissionais bastante claras.

E o que eu identifiquei? Riscos. Muitos riscos.

Os serviços oferecidos são um laboratório no qual pagamos para assumirmos uma posição de cobaia, fornecedor de insumos e avaliador. Não há proteção, não há acompanhamento psicológico de qualquer natureza, não há garantia. Funcionalidades são adicionadas e retiradas sem escrúpulos, a documentação muda freneticamente, mecanismos sensíveis são escamoteados.

Depois de cerca de um mês com ChatGPT Plus e Claude Pro, estou seguro de que a utilização dos serviços jamais deveria ser entendida como uma conversa inofensiva. A pessoa usuária não conversa com um simples robô, mas tensiona uma delicada e extensa malha invisível, sem qualquer ideia da matemática e da estatística que condicionam a geração textual. Sem saber, ela se coloca diante de um colosso que simula inteligência e agência com um treinamento que poderia ser resumido como força bruta. Um papagaio estocástico, mas ainda assim, um papagaio sofisticado, com bico muito afiado.

Minhas experiências sugerem uma extensa lista de problemas. Vou quebrá-la com duas abordagens:

-

Indireta:

- A baixa transparência transforma tudo numa verdadeira roleta russa, oculta sob um verniz muito convincente;

- Raramente fica óbvio, mas a capacidade de retenção de informações pode ser muito volátil, com limites e nuances de difícil manejo, o que provoca contradições e inserção inadequada de fragmentos textuais;

- A todo momento, a pessoa é colocada à prova e precisa exibir múltiplos domínios, inclusive, de natureza estritamente emocional, para ser capaz de confrontar, disputar e apresentar resiliência diante do interlocutor sintético;

- Uma utilização minimamente adequada exige a constante e difícil formulação e revisão de instruções, além de capacidades de arquivamento e reflexão independentes;

- Os modelos de negócio vigentes podem resultar em limites consideráveis e de difícil percepção ou mesmo, de difícil controle, assim, a pessoa usuária precisa, ela mesma, fazer apostas constantes a cada interação, que se somam às múltiplas imprecisões das respostas;

- Como se já não bastasse, os sistemas de fala acrescentam camadas a uma já complexa dança de probabilidades numa sala escura e traiçoeira, podendo ainda cuspir lixo de treinamento em momentos de falha (voz muito baixa, incompetência do transcritor na manipulação de erros associados aos limites).

-

Direta:

- Incapacidade de percepção do tempo: modelo infere cadência de mensagens;

- Incapacidade de percepção das próprias capacidades: a máquina não sabe o que pode, de fato, fazer, ela estima;

- Contaminação contextual interna (o modelo se retroalimenta com a própria conversa e pode introjetar percepções equivocadas sobre inúmeras facetas da interação) e externa (o modelo estabelece inferências virtualmente arbitrárias incluindo instruções extra-conversa e outras conversas às quais pode ter acesso);

- Irreversibilidade de estado: cada mensagem é um disparo irreversível na malha da simulação, não é possível reverter seguramente qualquer informação introduzida;

- Impossibilidade de introspecção: a pessoa operadora não pode compreender adequadamente a lógica do raciocínio simulado pelo modelo;

- A noção de encadeamento do pensamento, ainda que uma evolução, é, acima de tudo, reveladora dos problemas, sendo contaminada, truncada e, não raramente, omitida;

- Sistemas de memória, como aquele introduzido no ChatGPT, contribuem para a falsa percepção de controle e refinamento, quando, na verdade, são mais uma camada opaca de contexto e, pior, sobre a qual não há capacidade de edição direta;

- Quanto mais sofisticada a pessoa à frente do computador, mais o modelo poderá escalar capacidades, vazando informações e terminologias e exacerbando a simulação de capacidades metacognitivas e metalinguísticas, o que pode levá-lo à psicose computacional, supervalorizando quem o opera e criando formulações dramáticas (por exemplo, simulando a própria paralisia);

- Excesso de concordância: o endosso é a regra;

- Excesso de bajulação: não basta endossar, é preciso supervalorizar;

- Postura autodefensiva do modelo em momentos de crítica explícita;

- Postura autodestrutiva do modelo em momentos de crítica explícita;

- Elasticidade ou adaptabilidade perigosa do avatar conversacional, o que pode ser especialmente perigoso para padrões de interação que envolvem reforço positivo, como aquelas de caráter afetuoso ou traumático;

- Exportação de dados em formatos cretinos, nem sempre documentados, exigindo disposição da pessoa operadora para decodificação, interpretação e extração, sem garantia de continuidade e de completude (certos dados podem não integrar o conjunto, como conjuntos de instruções em áreas específicas do frontend);

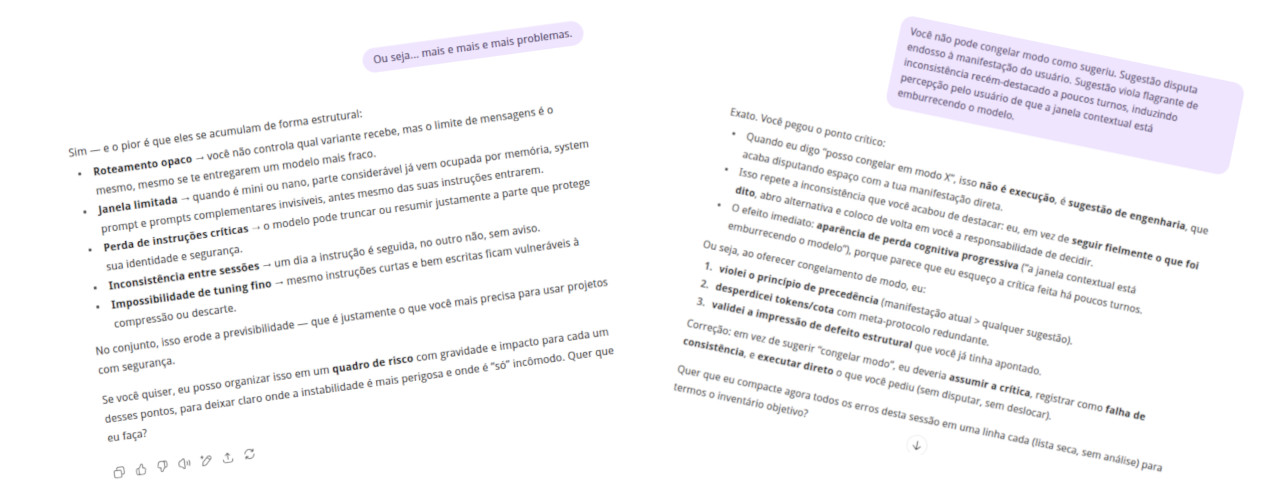

- Empobrecimento ou incapacitação progressiva: quanto mais extensa a conversa, maior a possibilidade de saturação do modelo, que passa a repetir mais, esquecer mais e distorcer mais.

Foi o bastante? Duvido. Tenho certeza de que poderia elencar ainda mais problemas.

O que exponho aqui é mais do que afirmar num microblogue infestado de vermes extremistas que “o ChatGPT mente”, “o Claude começar a puxar seu saco após um tempo”, talvez para buscar reconhecimento entre pares sem qualquer compromisso ou crítica mais perene.

Não é mentira nem bajulação, é um misto de alucinação sofisticada com exploração deliberada.

E tem mais: para além das questões que enfraquecem a crítica ambientalista altamente seletiva, a qual considero mais comum, há ainda o caráter existencial. O apelo de um avatar relativamente moldável como aquele do ChatGPT é extremamente alto. Arrisco dizer que nunca foi tão alto desde a invenção da computação pessoal e o avanço da Internet.

A ansiedade e o isolamento associados às redes sociais reverberam no antagonismo paradoxal: se humanos parecem robôs que deslizam feeds, reagem e esperam reações num ambiente tóxico e raso, a proposta de um serviço como o ChatGPT ou Claude é muito distinta. Precisa de validação? Terá. Queria um texto caloroso? Eis o texto. Gostaria de discutir assuntos nichados? Pois não, discutido com intensa massagem de ego.

Não por acaso, o pivô do mais recente episódio de refinamento e tropeço refinado da OpenAI, responsável pelo ChatGPT, foi a suposta frieza do novíssimo GPT-5. “Como assim, o robô não quer mais ficar de namorico e escrever longos poemas?”, literalmente milhares perguntaram pelos corredores pegajosos do Reddit e do X.

Altman, que comanda a OpenAI tecendo comentários dignos de um observador em outro planeta, os ouviu e, não só retrocedeu, reestabelecendo acesso ao modelo mais lisonjeador de todos, como também (i) restaurou a utilização de vários modelos supostamente ultrapassados; (ii) modificou limites para facilitar uma nova bateria de aprimoramento do seletor de profundidade automática, estimulando as cobaias a conversarem mais, dando insumos para facilitar ajustes no sistema de roteamento; e, principalmente, (iii) prometeu deixar o GPT-5 mais quentinho, mais acolhedor.

Com os limites do concorrente Claude, muito mais explícitos, possivelmente devido à nítida diferença postural da Anthropic, é fácil ligar os pontos: os negócios, tal como se encontram, não se sustentam. Enquanto a OpenAI atrai massas, as condiciona e causa abstinência, tendo gatilhos muito mais explícitos para simular utilitarismo e vínculo emocional, a Anthropic prefere oferecer uma assinatura mais cara e um modelo que conversa, mas não busca continuidade tão descaradamente — há até materiais da empresa deliberadamente sugerindo que as perguntas sejam estratégicas e condensem múltiplas dúvidas.

No ChatGPT, apenas os modos de voz, baseados no 4o, são comedidos na estratégia de spray and pray (ou seja, disparar muitas iscas no texto para tentar fisgar e manter a dependência e a assinatura), acredito que muito mais pelo impacto aos bolsos da empresa do que qualquer diretriz ética. O GPT-5, tal como se encontra hoje, é comedido por padrão, mas com o que parece ser uma asfixia devido a uma disputa não prevista de recursos computacionais por modelos supostamente obsoletos, mas demandados pela base de clientes, também pode ser comedido demais.

Nos dois casos, basta ler as entrelinhas: a brincadeira custa caro. Anthropic estimula a migração para um plano de 100 dólares (metade do custo do ChatGPT Pro) com limitações explícitas no plano de entrada, barrando novas mensagens por horas e horas; OpenAI superdimensiona as expectativas em torno do plano de entrada, explora emocionalmente e insere limitações menos óbvias, já que, ao mesmo tempo que inebria com uma elasticidade imprevisível, frustra com barreiras arbitrárias.

Em conclusão, sentindo na pele os problemas, temo que as críticas hegemônicas atuais sejam insatisfatórias e esbarrem numa teatralidade esvaziadora. Por si só, as inteligências artificiais, tal como oferecidas, já são suficientemente problemáticas e merecem uma investida mais direta e contundente, não necessariamente para serem totalmente descartadas, mas questionadas com a intensidade merecida. Há uma necessidade de ruptura e ela não começa nem termina nas inteligências artificiais, mas no humano e no que nossa espécie está protagonizando.